連載

#1 #ゆるテック

「持続が球菌」「魔方陣」…大臣の就任会見、音声認識してみると?

ネット上で公開されている会見の音声を「文字起こし」してみたら……?

連載

#1 #ゆるテック

ネット上で公開されている会見の音声を「文字起こし」してみたら……?

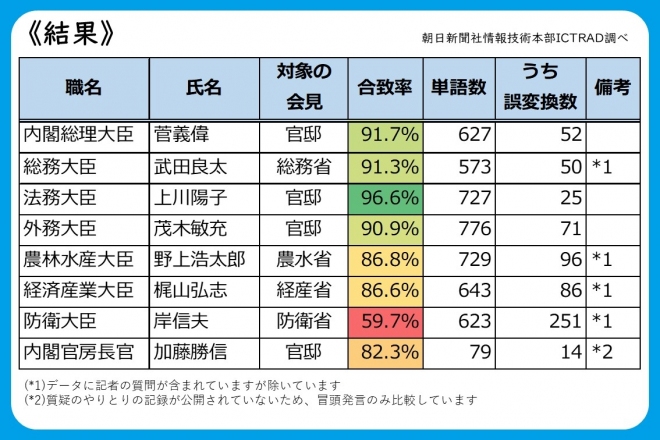

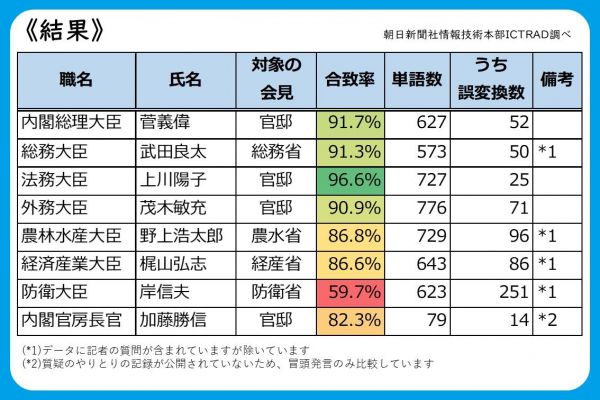

まず驚くべきことに、調査した8人の会見の半数である4人の会見は、発言趣旨の単語の90%以上を「機械」が聞き取ることができていました。

最も発言要旨との合致率が高かったのは、上川陽子法務大臣で96.6%です。音声からテキスト化された文章を見ても、ほとんどストレスなく読むことができるレベルになっていました。

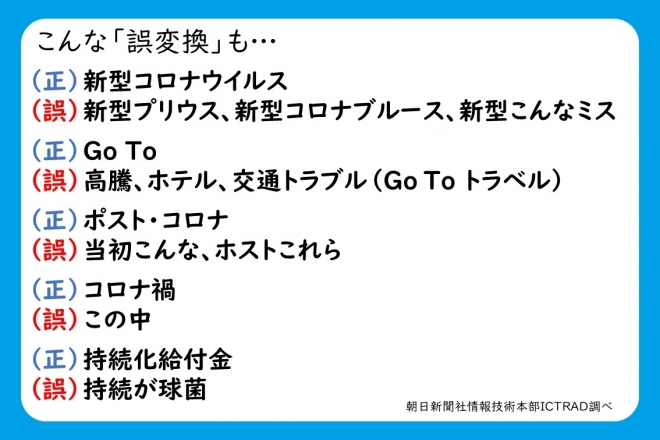

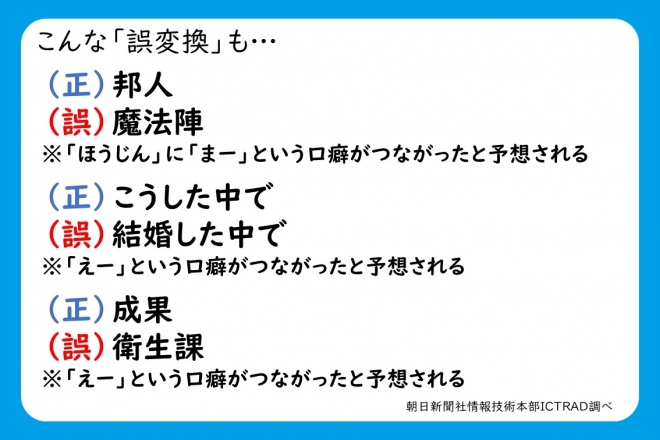

他にも、口癖に起因するような誤変換もありました。ついつい言ってしまう「あのー」「えーと」のような文脈上意味のない言葉は、「Speech to Text」ではほとんど省いて変換されています。しかし、単語の一部として認識されてしまっているケースもありました。

こうした口癖と同じように、畠山さんは「方言やイントネーションによっては正しく変換できない場合がある」といいます。

1/34枚